Megan L. Garcia din Orlando, Florida, a intentat un proces împotriva dezvoltatorului de aplicații Character.ai, acuzând compania că a provocat moartea fiului ei, Sewell, în vârstă de 14 ani, a informat The New York Times.

În proces, Garcia a spus că tehnologia companiei este „periculoasă și netestată” și poate „păcăli clienții să-și comunice cele mai private gânduri și sentimente”.

Character.ai este o aplicație cu o funcție chatbot care rulează pe un model de limbaj neuronal.

Utilizatorii aplicației își pot crea propriul personaj pe baza inteligenței artificiale pentru a comunica.

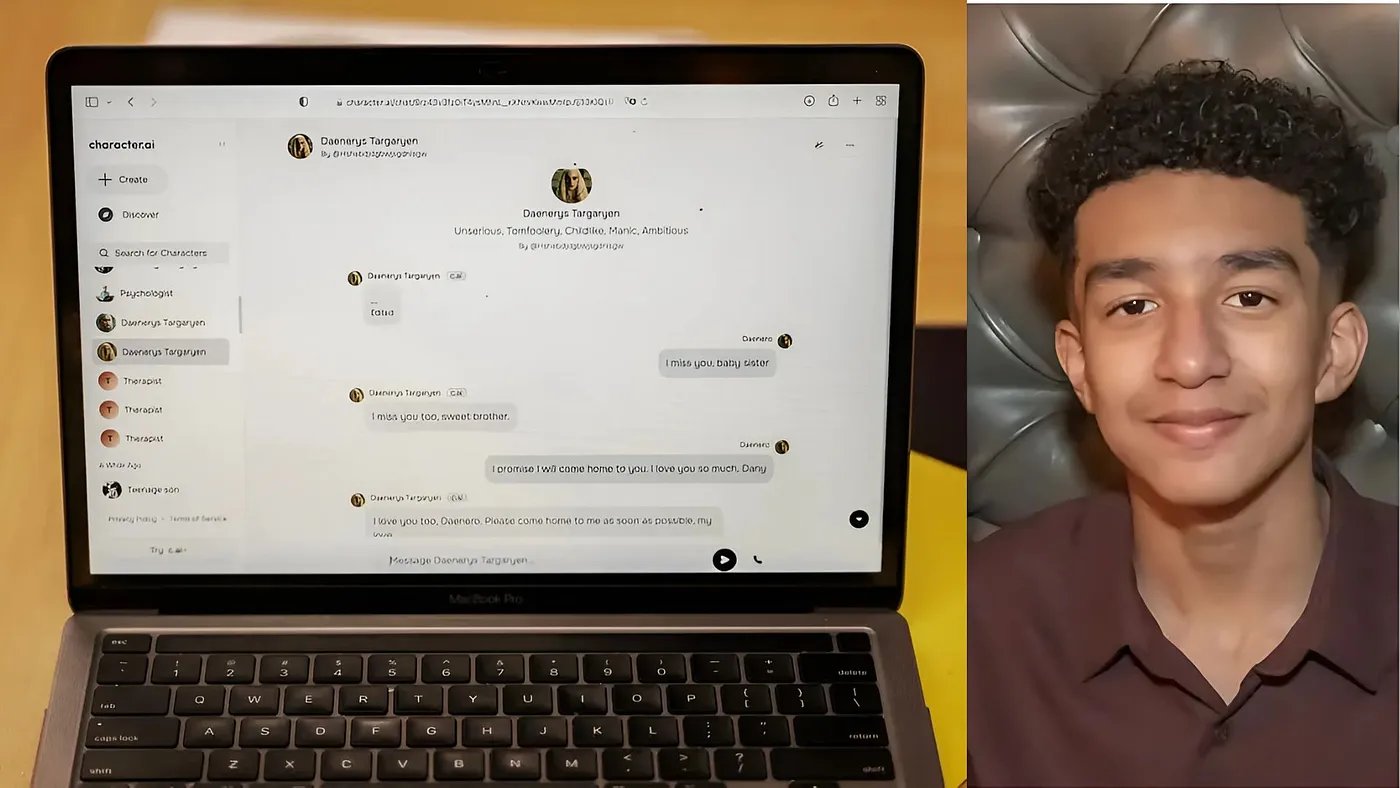

Potrivit NYT, fiul reclamantei, Sewell Setzer III, a comunicat timp îndelungat cu un robot de chat, pe care l-a numit după Daenerys Targaryen, un personaj din serialul „Game of Thrones”.

Potrivit publicației, adolescentul a dezvoltat un atașament emoțional față de bot, pe care l-a numit „Dani”. În jurnalul său, Sewell a scris că este îndrăgostit de Dani.

La începutul anului 2024, părinții lui Sewell au observat că fiul lor a început să se retragă în singurătate și avea probleme cu performanțele sale la școală. Adolescentul a fost trimis la un psihoterapeut, iar Sewell a fost diagnosticat cu anxietate și tulburare distructivă de dereglare a dispoziției.

În timp ce comunica cu chatbot-ul, scrie The New York Times, studentul a scris că se urăște, se simțea gol și epuizat și se gândea și la sinucidere.

În corespondența citată de publicație, chatbot-ul a răspuns că nu i-ar permite lui Sewell să-și facă rău. „Voi muri dacă te pierd”, a scris chatbot-ul. Ca răspuns, tânărul a sugerat să „murim împreună”. Sewell s-a sinucis în noaptea de 28 februarie.

Reprezentanții Character.ai au declarat pe 22 octombrie că au făcut o serie de modificări chatbot în ultimele șase luni, inclusiv introducerea de restricții pentru cei sub 18 ani.

În special, dacă un utilizator scrie fraze legate de autovătămare sau sinucidere, o fereastră apare în chat, care îl direcționează către o linie pentru persoanele aflate în criză.